구글, 128k 컨텍스트 윈도우를 가진 오픈 소스 Gemma 3 모델 공개

최근 대규모 언어 모델(LLM, Large Language Model)과 추론 모델이 인기를 끌고 있지만, 많은 기업들이 에너지 소비와 비용 문제를 줄이기 위해 소규모 모델로 눈을 돌리고 있다고 해요.

일부 기업들은 대형 모델을 축소하여 소형 버전을 만들기도 하지만, 구글(Google)과 같은 모델 제공업체는 성능이나 정확도를 크게 저하시키지 않으면서도 실행 비용이 더 많이 들 수 있는 대규모 언어 모델(LLM)의 대안으로 소규모 언어 모델(SLM, Small Language Model)을 계속 출시하고 있습니다.

이러한 추세에 발맞춰 구글은 확장된 컨텍스트 윈도우, 더 큰 매개변수, 향상된 멀티모달 추론 기능을 갖춘 최신 버전의 소형 모델인 Gemma를 공개했습니다.

Gemma 3의 특징

Gemini 2.0 모델과 동일한 처리 능력을 가진 Gemma 3는 여전히 휴대폰이나 노트북과 같은 소형 장치에서 가장 효율적으로 사용할 수 있습니다. 새로운 모델은 1B, 4B, 12B, 27B의 네 가지 크기로 제공됩니다.

Gemma 3는 128K 토큰의 더 큰 컨텍스트 윈도우를 가지고 있습니다. (Gemma 2는 80K 컨텍스트 윈도우를 가졌었습니다.) 이를 통해 더 많은 정보와 복잡한 요청을 이해할 수 있게 되었어요. 구글은 Gemma 3를 업데이트하여 140개 언어로 작동하고, 이미지, 텍스트, 짧은 비디오를 분석하며, 작업 및 에이전트 워크플로우를 자동화하기 위한 기능 호출을 지원하도록 했습니다.

Gemma의 강력한 성능

구글은 컴퓨팅 비용을 더욱 절감하기 위해 Gemma의 양자화된 버전을 도입했습니다. 양자화된 모델은 정확도를 희생하지 않고 “모델 가중치의 수치 값의 정밀도를 줄이는” 과정을 통해 압축된 모델이라고 생각하면 됩니다.

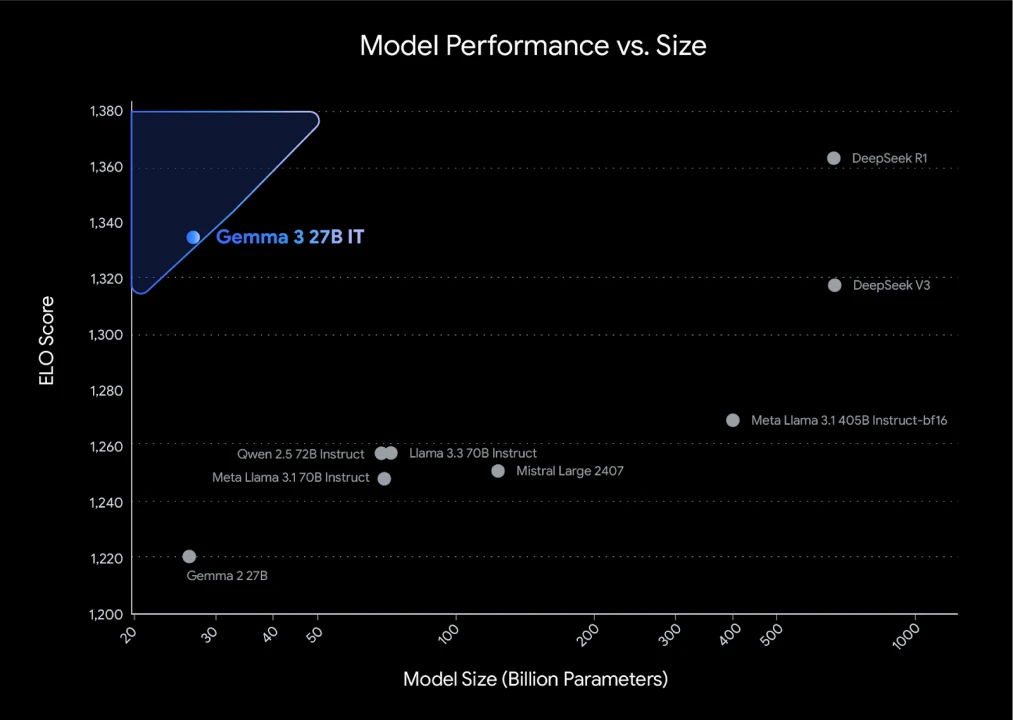

구글은 Gemma 3가 “크기에 비해 최첨단 성능을 제공”하며 Llama-405B, DeepSeek-V3, o3-mini와 같은 주요 LLM보다 성능이 뛰어나다고 밝혔습니다. 특히 Gemma 3 27B는 Chatbot Arena Elo 점수 테스트에서 DeepSeek-R1에 이어 2위를 차지했습니다. DeepSeek의 소형 모델인 DeepSeek v3, OpenAI의 o3-mini, Meta의 Llama-405B, Mistral Large를 능가하는 결과입니다.

Gemma 3를 양자화함으로써 사용자는 성능을 향상시키고, 모델을 실행하며, “단일 GPU 및 텐서 처리 장치(TPU) 호스트에 적합한” 애플리케이션을 구축할 수 있습니다.

Gemma 3는 Hugging Face Transformers, Ollama, JAX, Keras, PyTorch 등과 같은 개발자 도구와 통합됩니다. 사용자는 Google AI Studio, Hugging Face 또는 Kaggle을 통해 Gemma 3에 액세스할 수도 있습니다. 기업과 개발자는 AI Studio를 통해 Gemma 3 API에 대한 액세스를 요청할 수 있습니다.

보안을 위한 Shield Gemma

구글은 Gemma 3에 ShieldGemma 2라는 이미지 안전 검사기를 포함한 안전 프로토콜을 내장했다고 밝혔습니다.

구글은 블로그 게시물에서 “Gemma 3의 개발에는 광범위한 데이터 거버넌스, 미세 조정을 통한 안전 정책 준수, 강력한 벤치마크 평가가 포함되었습니다.”라고 밝혔습니다. “더 강력한 모델에 대한 철저한 테스트는 종종 덜 강력한 모델에 대한 평가에 영향을 미치지만, Gemma 3의 향상된 STEM 성능은 유해 물질 생성에 오용될 가능성에 초점을 맞춘 특정 평가를 촉발했습니다. 그 결과는 낮은 위험 수준을 나타냅니다.”

ShieldGemma 2는 Gemma 3를 기반으로 구축된 4B 매개변수 이미지 안전 검사기입니다. 성적으로 노골적인 콘텐츠, 폭력 및 기타 위험한 자료가 포함된 이미지에 대한 모델의 응답을 찾아 방지합니다. 사용자는 특정 요구 사항에 맞게 ShieldGemma 2를 사용자 정의할 수 있습니다.

소형 모델과 지식 증류의 부상

구글이 2024년 2월에 Gemma를 처음 출시한 이후로 SLM에 대한 관심이 증가했습니다. Microsoft의 Phi-4 및 Mistral Small 3와 같은 다른 소형 모델은 기업이 LLM만큼 강력하지만 LLM이 제공할 수 있는 모든 기능을 반드시 사용할 필요는 없는 모델로 애플리케이션을 구축하기를 원한다는 것을 나타냅니다.

기업은 또한 증류를 통해 선호하는 LLM의 소형 버전으로 전환하기 시작했습니다. 분명히 하자면 Gemma는 Gemini 2.0의 증류가 아닙니다. 오히려 동일한 데이터 세트와 아키텍처로 훈련되었습니다. 증류된 모델은 더 큰 모델에서 학습하지만 Gemma는 그렇지 않습니다.

조직은 특정 사용 사례를 모델에 맞추는 것을 선호하는 경우가 많습니다. o3-mini 또는 Claude 3.7 Sonnet과 같은 LLM을 간단한 코드 편집기에 배포하는 대신 SLM이든 증류된 버전이든 더 작은 모델은 거대한 모델을 과적합하지 않고도 이러한 작업을 쉽게 수행할 수 있습니다.