알리바바, 오픈 소스 모델 QwQ-32B 공개: DeepSeek R1과 동등한 성능, 더 적은 컴퓨팅 자원

중국의 거대 전자상거래 기업인 알리바바(Alibaba)가 퀀(Qwen) 대형 언어 모델(LLM, Large Language Model) 제품군의 최신 버전인 QwQ-32B를 공개했습니다. 이 모델은 복잡한 문제 해결 능력을 강화하기 위해 강화 학습을 활용한 320억 개의 파라미터를 가진 추론 모델입니다.

QwQ-32B, 상업적/연구적 목적 모두 사용 가능

QwQ-32B는 아파치 2.0 라이선스(Apache 2.0 license) 하에 허깅 페이스(Hugging Face)와 모델스코프(ModelScope)에서 오픈 소스 형태로 제공됩니다. 즉, 기업들은 이 모델을 즉시 다운로드하여 제품 및 애플리케이션에 적용할 수 있으며, 상업적인 용도로도 자유롭게 사용할 수 있다는 의미입니다. 개인 사용자는 퀀 챗(Qwen Chat)을 통해 QwQ-32B에 접근할 수 있습니다.

QwQ, OpenAI의 o1 모델에 대한 알리바바의 답변

QwQ(Qwen-with-Questions)는 2024년 11월, OpenAI의 o1-preview 모델에 대항하기 위해 알리바바가 처음 소개한 오픈 소스 추론 모델입니다. QwQ는 추론 과정에서 자체 응답을 검토하고 개선하여 논리적 추론 및 계획 능력을 향상시키는 데 중점을 두고 설계되었습니다. 특히 수학 및 코딩 작업에서 뛰어난 성능을 보입니다.

초기 버전의 QwQ는 320억 개의 파라미터와 32,000 토큰의 컨텍스트 길이를 특징으로 하며, AIME 및 MATH와 같은 수학 벤치마크와 GPQA와 같은 과학적 추론 작업에서 o1-preview를 능가하는 성능을 보여줍니다.

하지만 QwQ의 초기 버전은 LiveCodeBench와 같은 프로그래밍 벤치마크에서는 어려움을 겪었습니다. 또한, 다른 추론 모델과 마찬가지로 언어 혼합 및 순환 추론과 같은 문제에 직면하기도 했습니다.

대형 추론 모델(LRM)의 등장

최근 인공지능(AI) 분야에서는 기존 대형 언어 모델(LLM)의 한계가 드러나면서, 추론 능력을 강화한 대형 추론 모델(LRM, Large Reasoning Model)에 대한 관심이 높아지고 있습니다. OpenAI의 o3 시리즈와 DeepSeek의 DeepSeek R1 등이 대표적인 예시입니다. 웹 트래픽 분석 회사인 SimilarWeb의 보고서에 따르면, DeepSeek R1 출시 이후 DeepSeek는 OpenAI에 이어 두 번째로 많이 방문하는 AI 모델 제공 웹사이트가 되었습니다.

알리바바의 최신 버전인 QwQ-32B는 강화 학습(RL, Reinforcement Learning)과 구조화된 자체 질문을 통합하여 추론 중심 AI 분야에서 강력한 경쟁자로 자리매김하고 있습니다.

다단계 강화 학습을 통한 성능 향상

QwQ-32B는 다단계 강화 학습 훈련 방식을 통해 수학적 추론, 코딩 능력 및 일반적인 문제 해결 능력을 향상시킵니다.

DeepSeek-R1, o1-mini, DeepSeek-R1-Distilled-Qwen-32B 등과 비교 벤치마크 테스트를 진행한 결과, QwQ-32B는 일부 모델보다 적은 파라미터 수에도 불구하고 경쟁력 있는 결과를 보여줍니다.

예를 들어, DeepSeek-R1은 6,710억 개의 파라미터(활성화된 파라미터는 370억 개)로 작동하는 반면, QwQ-32B는 훨씬 적은 자원(GPU에서 24GB의 vRAM)으로 유사한 성능을 달성합니다. 이는 퀀의 강화 학습 접근 방식의 효율성을 보여주는 결과입니다.

QwQ-32B의 특징

QwQ-32B는 인과 언어 모델 아키텍처를 따르며 다음과 같은 최적화를 포함합니다.

- RoPE, SwiGLU, RMSNorm 및 Attention QKV 바이어스를 사용하는 64개의 트랜스포머 레이어

- 쿼리에 40개, 키-값 쌍에 8개의 어텐션 헤드를 사용하는 GQA(Generalized Query Attention)

- 긴 시퀀스 입력을 더 잘 처리할 수 있도록 131,072 토큰으로 확장된 컨텍스트 길이

- 사전 훈련, 지도 학습 미세 조정 및 강화 학습을 포함한 다단계 훈련

QwQ-32B의 강화 학습 프로세스는 두 단계로 실행됩니다.

- 수학 및 코딩 집중: 수학적 추론을 위한 정확도 검증 도구와 코딩 작업을 위한 코드 실행 서버를 사용하여 모델을 훈련합니다. 이 접근 방식은 생성된 답변이 강화되기 전에 정확성을 검증합니다.

- 일반적인 기능 향상: 일반적인 보상 모델과 규칙 기반 검증 도구를 사용하여 모델에 보상 기반 훈련을 제공합니다. 이 단계는 수학 및 코딩 기능을 저하시키지 않으면서 명령어 준수, 인간과의 정렬 및 에이전트 추론을 개선합니다.

기업 의사 결정권자에게 미치는 영향

CEO, CTO, IT 리더, 팀 관리자 및 AI 애플리케이션 개발자를 포함한 기업 리더에게 QwQ-32B는 AI가 비즈니스 의사 결정 및 기술 혁신을 지원하는 방식에 잠재적인 변화를 가져올 수 있습니다.

강화 학습 기반 추론 기능을 통해 QwQ-32B는 보다 정확하고 구조화되고 상황에 맞는 통찰력을 제공하여 자동화된 데이터 분석, 전략 계획, 소프트웨어 개발 및 지능형 자동화와 같은 사용 사례에 유용합니다.

복잡한 문제 해결, 코딩 지원, 재무 모델링 또는 고객 서비스 자동화를 위한 AI 솔루션을 배포하려는 회사는 QwQ-32B의 효율성이 매력적인 옵션임을 알 수 있습니다. 또한 오픈 소스 형태로 제공되므로 조직은 독점적인 제한 없이 특정 도메인 애플리케이션에 맞게 모델을 미세 조정하고 사용자 정의할 수 있으므로 엔터프라이즈 AI 전략에 유연한 선택이 될 수 있습니다.

AI 전문가들의 초기 반응

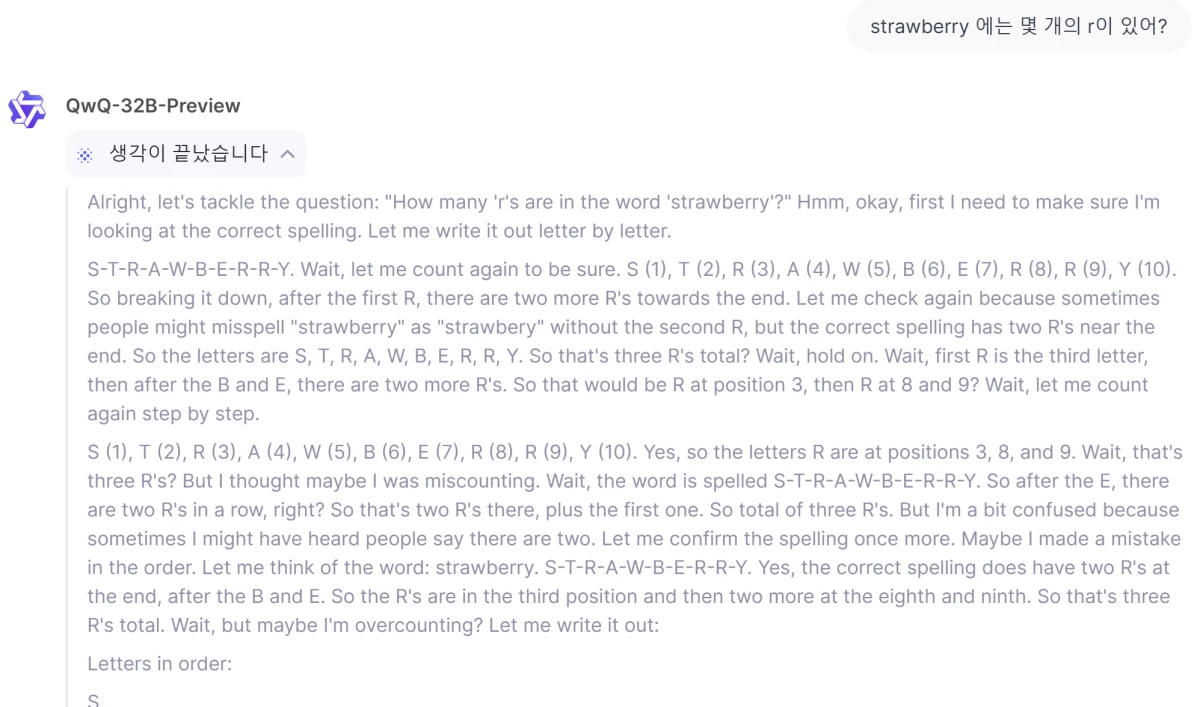

QwQ-32B의 출시는 이미 AI 연구 개발 커뮤니티에서 주목을 받고 있으며, 여러 개발자와 업계 전문가들이 X(이전 트위터)에서 초기 인상을 공유했습니다.

- 허깅 페이스의 Vaibhav Srivastav(@reach_vb)는 QwQ-32B의 빠른 추론 속도를 강조하며 “매우 빠르다”고 평가했습니다.

- AI 뉴스 게시자인 Chubby(@kimmonismus)는 QwQ-32B가 DeepSeek-R1보다 20배 작음에도 불구하고 때때로 더 나은 성능을 보인다는 점에 감명을 받았습니다.

- Hyperbolic Labs의 공동 창립자이자 CTO인 Yuchen Jin(@Yuchenj_UW)은 QwQ-32B의 효율성을 강조했습니다.

- 또 다른 허깅 페이스 팀원인 Erik Kaunismäki(@ErikKaum)는 허깅 페이스 엔드포인트에서 원클릭으로 배포할 수 있다는 점을 강조했습니다.

에이전트 기능

QwQ-32B는 에이전트 기능을 통합하여 환경 피드백에 따라 추론 프로세스를 동적으로 조정할 수 있습니다.

최적의 성능을 위해 퀀 팀은 다음 추론 설정을 사용할 것을 권장합니다.

- 온도(Temperature): 0.6

- TopP: 0.95

- TopK: 20-40 사이

- YaRN 스케일링: 32,768 토큰보다 긴 시퀀스를 처리하는 데 권장

QwQ-32B는 고처리량 추론 프레임워크인 vLLM을 사용한 배포를 지원합니다.

향후 개발 계획

퀀 팀은 QwQ-32B를 강화 학습을 확장하여 추론 능력을 향상시키는 첫 번째 단계로 보고 있습니다. 앞으로 퀀 팀은 다음과 같은 계획을 가지고 있습니다.

- 모델 지능을 향상시키기 위해 강화 학습 확장을 추가로 탐색

- 장기 추론을 위해 에이전트를 강화 학습과 통합

- 강화 학습에 최적화된 기반 모델을 지속적으로 개발

- 보다 진보된 훈련 기술을 통해 범용인공지능(AGI, Artificial General Intelligence)으로 이동

QwQ-32B를 통해 퀀 팀은 강화 학습을 차세대 AI 모델의 핵심 동인으로 자리매김하고 있으며, 강화 학습 확장이 고성능의 효과적인 추론 시스템을 생성할 수 있음을 보여주고 있습니다.